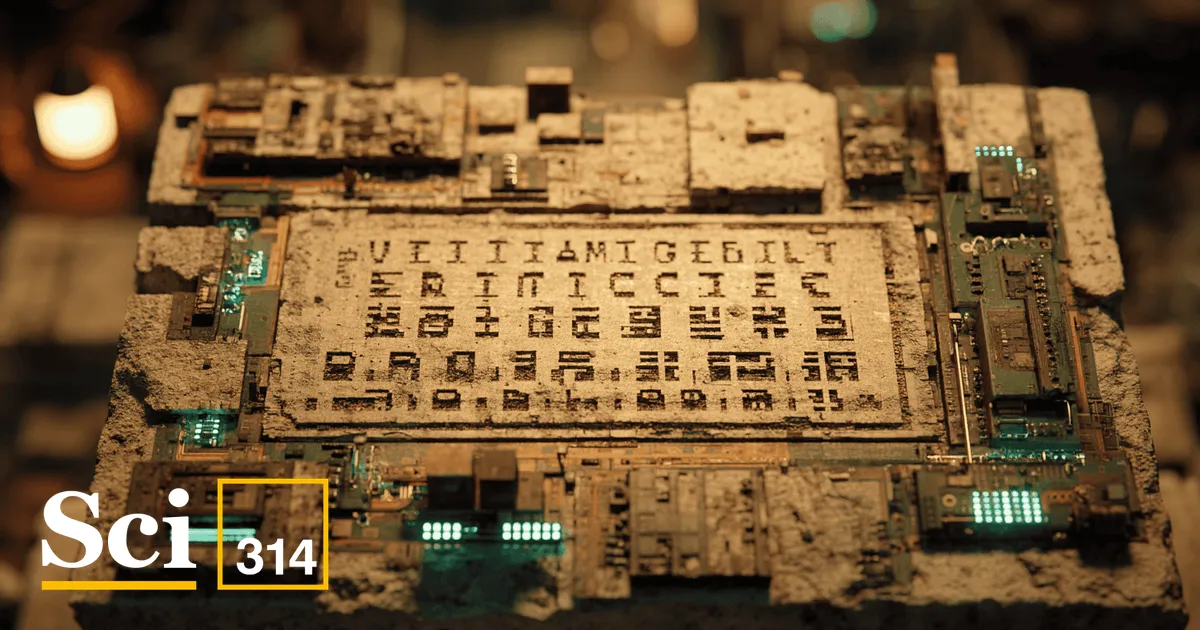

Як штучний інтелект формує "цифрові залишки" у науковій сфері

Вчені з'ясували, що помилки, допущені штучним інтелектом, можуть невиправно спотворити результати наукових досліджень.

Сучасна наукова спільнота зіткнулася з новою та незвичною проблемою, що виникла через швидкий прогрес у галузі штучного інтелекту та машинного навчання. Дослідницька група під керівництвом Аарона Дж. Сноссвелла нещодавно виявила вражаючий феномен, відомий як "цифрові скам'янілості" – це терміни та висловлювання, які з'являються через технічні збої, але з часом закріплюються в системах знань штучного інтелекту.

Яскравим прикладом цього феномену є абсолютно абсурдний термін "вегетативна електронна мікроскопія", що виник через кілька випадкових технічних помилок. По-перше, його поява пов'язана з процесом оцифровування наукових публікацій 1950-х років. Під час сканування документів програмне забезпечення для оптичного розпізнавання символів (OCR) випадково з'єднало два слова з різних колонок – "вегетативна" і "електронна мікроскопія".

Друга хвиля популяризації цього псевдонаукового терміна викликана помилками в перекладі. У фарсі (перській мові) терміни "вегетативна" та "скануючи" мають лише одну крапкову різницю, що призвело до виникнення нелогічного словосполучення в наукових статтях 2017 та 2019 років.

Найбільш тривожним є те, що цей хибний термін з'явився принаймні в 22 наукових статтях. Деякі публікації були виправлені або взагалі вилучені, проте шкода вже була завдана. Навіть впливова іспанська газета El País цитувала цей вираз у 2023 році.

Проблема криється в механізмах навчання сучасних систем штучного інтелекту. Вони trained на величезних масивах даних, і коли такий абсурдний термін потрапляє в декілька авторитетних джерел, штучний інтелект починає сприймати його як легітимний науковий вираз. Коли дослідники використовують ШІ для допомоги в написанні статей, системи можуть некритично відтворювати такі помилки.

Дослідники виявили, що ця помилка зберігається навіть у найсучасніших моделях, включаючи GPT-4o та Claude 3.5. Це свідчить про те, що такі "цифрові скам'янілості" можуть назавжди закріпитися в базах знань штучного інтелекту.

Різні рівні залучені в боротьбу з цією проблемою. Наприклад, інструмент Problematic Paper Screener щотижня аналізує 130 мільйонів наукових статей, застосовуючи дев'ять різних детекторів для виявлення неналежного використання штучного інтелекту. У журналі Springer Nature's Environmental Science and Pollution Research було виявлено 78 публікацій з проблемами.

Наукові журнали також намагаються протидіяти цій тенденції. Компанія Elsevier, наприклад, спочатку намагалася виправдати використання терміну "вегетативна електронна мікроскопія", але зрештою була змушена випустити офіційне виправлення.

Основна загроза полягає в тому, що подібні випадкові помилки можуть стати невід'ємною частиною наукового запису. Наука розвивається поступово, і якщо ми формуємо наукові теорії на основі неправильних даних, це може призвести до серйозних наслідків.

Ця обставина акцентує увагу на важливості критичного мислення та ретельної перевірки фактів, особливо в часи, коли штучний інтелект набирає популярності. Дослідникам варто бути максимально уважними і обережними, переглядаючи кожен термін і джерело інформації.